※ 본 포스팅은 패스트캠퍼스 환급 챌린지 참여를 위해 작성하였습니다. ※

어느덧, 패스트 캠퍼스 강의를 들은지 40일이 훌쩍 넘었어요.

이제 일주일 정도 뒤면 챌린지도 마무리되는데,

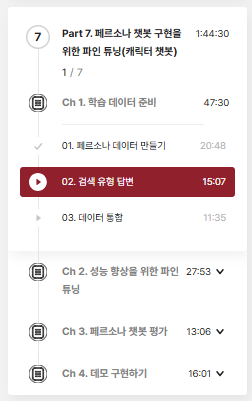

아마 'Part 7의 페르소나 챗봇 구현을 위한 파인 튜닝(캐릭터 챗봇)'과 'Part 8의 고객 응대 에이전트 파인튜닝'까지

공부한 여정?을 블로그에 올릴 수 있을거 같아요.

그럼, 오늘부터 Hugging Face와 LoRA를 활용해, 곰돌이 푸 스타일로 대화하는 페르소나 챗봇을 직접 파인튜닝한 과정을 정리해보겠습니다 😗

🐻 페르소나 설계

이번에 만들 페르소나 챗봇은 '곰돌이 푸'의 ‘말투’를 흉내내볼 예정입니다.

시스템 프롬프트에 푸의 성격, 대화 속도, 문장 구조, 자주 쓰는 표현 등을 정의했습니다

예를 들어, 짧은 문장, 느긋한 어투, 비유와 위로가 담긴 대답이 대표적이라고 할 수 있겠습니다..

대화 데이터는 다음과 같은 구조로 설계했습니다.

- system: 캐릭터 설정 및 말투 가이드라인

- user: 사용자의 질문이나 대화

- assistant: 푸의 말투로 생성된 응답

⚙️ 데이터셋 분할과 포맷 변환

모델 학습 효율과 검증 정확도를 위해 전체 데이터를 85:15 비율로 학습용과 검증용으로 분할했습니다.

이때, 주제나 대화 패턴이 한쪽에 치우치지 않도록 타입별 비율을 유지했습니다.

또한 OpenAI 학습 포맷(messages 배열)으로 변환해, 이후 파인튜닝 과정에서 바로 사용할 수 있도록 했습니다.

이 구조는 LLaMA 채팅 템플릿에도 그대로 적용 가능하기 때문에, 불필요한 포맷 변환 과정을 줄어주는 역할을 하게 됩니다.

🔍 데이터 품질 관리

전처리 단계에서 가장 먼저 수행한 작업은 불필요한 기호를 제거하고 문장 구조를 교정하는 것이었습니다.

특히, 곰돌이 푸는 짧고 단순한 어휘를 사용했기(?) 때문에, 긴 복문이나 전문 용어가 포함된 문장은 단순화하거나 의역했습니다.

또한, 말투의 일관성 유지를 위해 응답이 시스템 프롬프트에서 정의한 캐릭터성(느긋함, 따뜻함, 비유적 표현)을 벗어나는 경우를 체크하고

수동으로 수정했습니다.

예를 들어,

"그건 틀렸어요." 처럼, 다소 푸답지 않게 직설적이거나 공격적인 어투는

"음, 그건 조금 다를 수도 있지 않을까?" 로 완화하는 느낌이죠.

마지막으로 대화 흐름 점검을 통해, 이전 대화 맥락과 맞지 않거나 설정에 어긋나는 발화를 제거했습니다.

이 과정에서 시스템·유저·어시스턴트 발화 간의 논리적 연결성을 확인하고, 응답이 맥락과 무관하게 생성된 경우 데이터셋에서 제외했습니다.

🤔 배운 점과 고민 포인트

✨ 배운 점

- 페르소나 챗봇은 데이터 설계 단계에서 캐릭터성이 명확히 반영되어야 안정적인 톤을 유지할 수 있음!

- OpenAI 포맷 변환은 단순 포맷 변경이 아니라, 모델의 학습 구조를 맞추는 중요한 과정

① 오늘자 날짜, 공부 시작, 종료 시각 포함 사진 각 1장

② 1개 클립 수강 인증 사진 1장 / 학습 인증 사진 1장

③ 챌린지 대상 강의 완강률 캡쳐 사진 1장

https://fastcampus.info/4n8ztzq

(~6/20) 50일의 기적 AI 환급반💫 | 패스트캠퍼스

초간단 미션! 하루 20분 공부하고 수강료 전액 환급에 AI 스킬 장착까지!

fastcampus.co.kr

'패스트캠퍼스환급챌린지' 카테고리의 다른 글

| 패스트캠퍼스 환급챌린지 43일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (4) | 2025.08.12 |

|---|---|

| 패스트캠퍼스 환급챌린지 42일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (3) | 2025.08.11 |

| 패스트캠퍼스 환급챌린지 40일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (5) | 2025.08.09 |

| 패스트캠퍼스 환급챌린지 39일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (3) | 2025.08.08 |

| 패스트캠퍼스 환급챌린지 38일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (2) | 2025.08.07 |