※ 본 포스팅은 패스트캠퍼스 환급 챌린지 참여를 위해 작성하였습니다. ※

LLM... 트랜스포머... 인코더/디코더 등등. 지난 시간에 대해 기초적인 개념을 강의를 통해 훑었는데요. 사실 관련 논문을 아직 읽어보지는 못해서 두루뭉술한 감이 없지않아 있었습니다.이번에 들은 강의는 조금이나마 궁금증을 해소 시켜주었던 강의였던 것 같아요.인코더 Only BERT와 BERT로 해결할 수 있는 문제들에 대해 간략히 공부했습니다 :)

셀프 어텐션은 어떻게 문맥을 이해할까?

트랜스포머의 핵심은 바로 ‘셀프 어텐션(Self-Attention)’.

하나의 단어가 문장 내 다른 단어들과 얼마나 관련이 있는지를 스스로 계산하는 구조입니다.

예를 들어,

“그 동물은 길을 건너지 않았다. 왜냐하면 그것은 너무 피곤했기 때문이다.”

라는 문장이 입력되었다고 해볼게요.

여기서 ‘그것’이 가리키는 건 ‘동물’이죠.

셀프 어텐션은 이런 관계를 스스로 학습하여 단어 간의 실제 의미 연결성을 반영합니다.

이게 바로 기존 RNN 구조와는 차원이 다른 이해력을 제공하는 이유죠.

BERT, “앞뒤를 모두 본다!”

BERT(Bidirectional Encoder Representations from Transformers)는 트랜스포머 구조에서 인코더만 떼어 만든 모델입니다.

"양방향 문맥 이해"가 그 핵심이라고 해요.

이를 위해 Masked Language Model 학습방식을 채택합니다.

문장에서 임의의 단어를 [MASK] 처리하고, 해당 단어가 무엇이었는지를 양쪽 문맥을 활용해 맞추도록 학습시킵니다.

추가로, BERT는 사전학습 단계에서 Next Sentence Prediction 문제를 풀게됩니다.

[SEP] 토큰으로 구분되는 여러개의 문장을 입력하고, 입력된 문장들 앞에 붙은 [CLS] 토큰에서 구분된 문장이 이어지는 문장인지를 맞추는 문제입니다.

이 역시, BERT가 가진 문맥이해능력을 강화시키는 학습이죠.

이 두 가지 학습은 동시에 이루어지게 됩니다.

글을 못 쓰는 BERT, 하지만 의미를 ‘이해’한다

BERT는 "GPT처럼 창작하는 일"에는 어울리지 않습니다.

하지만 다음과 같은 문제에는 강력하다고 합니다.

1) 텍스트 분류 : 이 문서는 어떤 카테고리에 속할까?

2) 개체명 인식(NER): 문장에서 사람 이름, 장소 이름 등 고유명사를 뽑고 싶어

3) 의미 기반 임베딩: 문장의 의미를 수치화(벡터)해 볼까?

지금 재직 중인 회사의 프로젝트 중 하나인 '모두의 지도'는 엑셀로 제작된 장소 데이터를 기반으로 지도를 제작할 수 있습니다.

이 때, 장소 데이터 중에서 주소 값이 위치한 칼럼을 추출하는 기능이 구현되어있는데요.

자세히 열어보지는 않았지만, BERT에 기반한 임베딩을 활용하는게 아닐까? 라는 생각이 들었네요.

내일 출근해서 프로젝트 한번 뜯어봐야겠습니다 😋

① 오늘자 날짜, 공부 시작, 종료 시각 포함 사진 각 1장

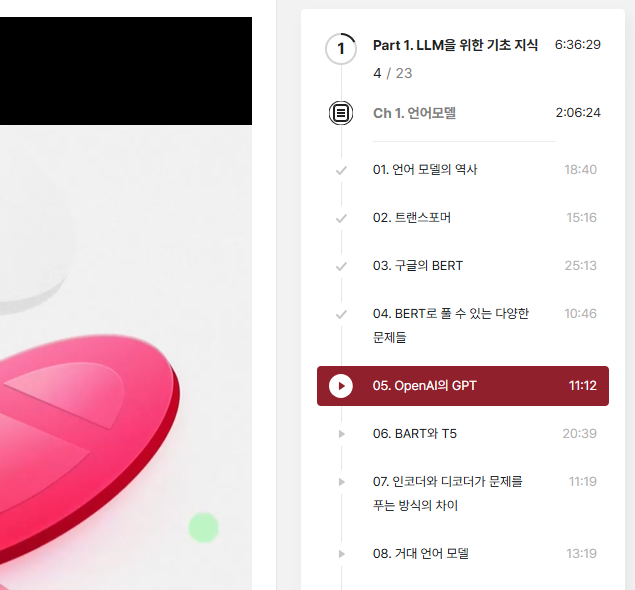

② 1개 클립 수강 인증 사진 1장 / 학습 인증 사진 1장

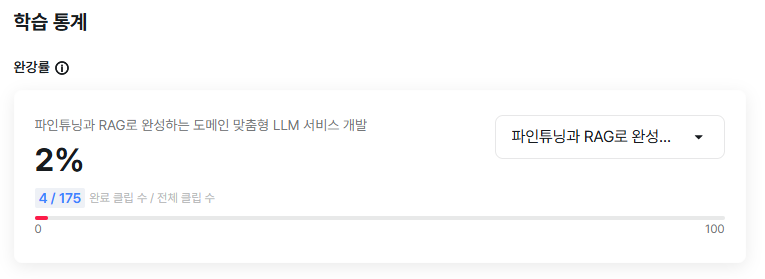

③ 챌린지 대상 강의 완강률 캡쳐 사진 1장

https://fastcampus.info/4n8ztzq

(~6/20) 50일의 기적 AI 환급반💫 | 패스트캠퍼스

초간단 미션! 하루 20분 공부하고 수강료 전액 환급에 AI 스킬 장착까지!

fastcampus.co.kr

'패스트캠퍼스환급챌린지' 카테고리의 다른 글

| 패스트캠퍼스 환급챌린지 6일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (4) | 2025.07.06 |

|---|---|

| 패스트캠퍼스 환급챌린지 5일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (3) | 2025.07.05 |

| 패스트캠퍼스 환급챌린지 4일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (1) | 2025.07.04 |

| 패스트캠퍼스 환급챌린지 3일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (1) | 2025.07.03 |

| 패스트캠퍼스 환급챌린지 1일차 : 파인튜닝과 RAG로 완성하는 맞춤형 LLM 서비스 개발 강의 후기 (5) | 2025.07.01 |